Los chatbots de árbol de decisión suelen funcionar mejor para dudas simples y previsibles, con poca variación y sin necesidad de contexto. En cambio, los agentes de IA tienen más sentido en operaciones con alto volumen, múltiples excepciones y la necesidad de resolver casos de punta a punta.

Si estás evaluando el uso de chatbots para mejorar el servicio de tu empresa, entender cuál es el modelo correcto para tu escenario es esencial para no generar el efecto contrario. En lugar de ganar eficiencia, una decisión errónea puede crear más fricción, sobrecargar al equipo y comprometer la experiencia del cliente.

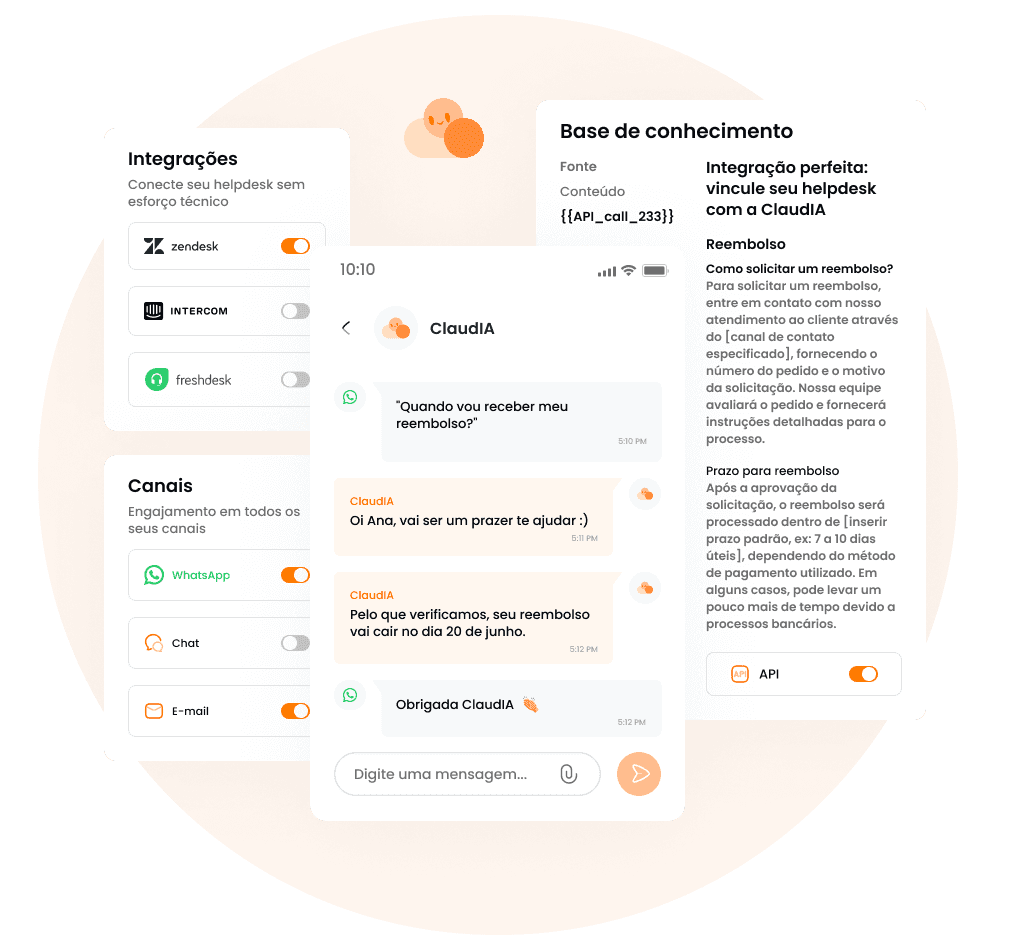

Este impacto aparece aún más rápido en canales críticos, como WhatsApp, que es la preferencia entre los usuarios en Brasil y donde la expectativa de respuesta es inmediata. Con altos volúmenes de contacto, el equipo humano sigue absorbiendo buena parte de los atendimientos, el costo operacional crece y el cliente se frustra con respuestas rígidas.

Cuándo cada enfoque tiene más sentido:

Los chatbots de árbol de decisión funcionan bien cuando hay dudas simples y repetitivas, catálogos pequeños o poco variables, pocas excepciones, baja necesidad de integración con sistemas y cuando se acepta una cobertura limitada.

Los agentes de IA tienen más sentido cuando existe un alto volumen de atendimientos, gran variedad de casos y excepciones (edge cases), WhatsApp es un canal crítico y hay necesidad de entender el contexto, ejecutar acciones y evolucionar con el uso.

En la práctica, el camino más común en operaciones reales es comenzar con un recorte claro (principales intenciones), medir retención, escapes y calidad, y escalar de forma progresiva, con gobernanza.

¿Qué es un chatbot de árbol de decisión?

Un chatbot de árbol de decisión es un sistema de atención automatizado basado en flujos predefinidos. Guía al usuario a través de una secuencia de preguntas y respuestas, normalmente en formato de botones o menús, hasta llegar a un desenlace específico. Cada elección lleva a un nuevo camino, como en un diagrama de flujo.

Este tipo de chatbot no entiende el contexto ni “interpreta” el mensaje del cliente. Solo ejecuta reglas: si el usuario elige A, sigue para el flujo A; si elige B, va para el flujo B. Todo lo que el bot responde debe haber sido previamente mapeado, escrito y mantenido por alguien del equipo.

Qué es un agente de IA en la atención

Un agente de IA, a diferencia del modelo anterior, entiende la intención detrás del mensaje, considera el contexto de la conversación y decide cómo responder o actuar, incluso cuando la solicitud llega incompleta, fuera de orden o escrita de manera diferente a lo esperado.

Mientras que los chatbots tradicionales fallan cuando el cliente se sale del guion y generan el “no entendí”, el agente de IA puede interpretar variaciones de lenguaje, retomar información mencionada anteriormente y mantener coherencia a lo largo de la conversación. El cliente no necesita adaptarse al bot, el bot se adapta al cliente.

Además de responder, un agente de IA puede consultar bases de conocimiento, seguir políticas definidas por la empresa, ejecutar acciones en sistemas internos y, cuando es necesario, hacer una transición para la atención humana con contexto, historial e intención claros. El resultado es una atención más fluida, menos repetitiva y que realmente reduce el esfuerzo operativo, en lugar de solo redistribuirlo.

Cuándo el árbol de decisión todavía es mejor

A pesar de las limitaciones, los chatbots basados en árbol de decisión funcionan mejor cuando el problema es simple, predecible y poco variable. Por eso, este modelo suele ser suficiente cuando:

El volumen de dudas es bajo o moderado, con poca variación en la forma en que los clientes preguntan.

Los procesos son fijos y bien definidos, sin muchas excepciones o decisiones condicionales.

El objetivo del bot es solo selección o direccionamiento, no resolución completa.

El equipo es pequeño y necesita algo fácil de controlar, aunque esté limitado.

Existe necesidad de control extremo de la respuesta, ya sea por riesgo regulatorio, cumplimiento o falta de gobernanza de IA madura.

En estos escenarios, el esfuerzo de implementar y gobernar un agente de IA puede no ser rentable a corto plazo. Un flujo simple, bien diseñado y con pocos caminos puede resolver el problema sin añadir complejidad técnica u operativa.

Cuando el agente de IA es claramente superior

El agente de IA se convierte en la mejor elección cuando la operación deja de ser predecible y comienza a lidiar con volumen, variación y contexto al mismo tiempo. En otras palabras: cuando el problema ya no es “responder”, sino resolver de punta a punta.

💡 Estudios de McKinsey indican que hasta el 70% de los contactos de atención son repetitivos, lo que hace que los modelos rígidos sean difíciles de sostener a medida que el volumen crece.

Este modelo se destaca cuando:

Existe mucho volumen de contactos repetitivos, pero con diversas formas de preguntar lo mismo. El cliente no sigue guiones y el bot necesita entender la intención, no la palabra clave.

El WhatsApp es el canal principal de la operación, con alto volumen, urgencia y baja tolerancia a la fricción. Menús largos y flujos rígidos rompen la experiencia rápidamente.

La respuesta depende del contexto: pedido, plan contratado, historial del cliente, estado anterior o acciones ya realizadas en la conversación.

La atención exige acciones reales, como consultar pedidos, generar boleto o PIX, abrir casos, alterar datos o seguir procesos internos.

La meta es reducir N1 humano de verdad, liberando al equipo para casos más complejos, y no solo “mantener” al cliente por unos segundos antes de transferirlo.

En estos escenarios, intentar escalar con árbol de decisión suele generar el efecto contrario: más frustración, más excepciones y más tickets humanos. El agente de IA, por otro lado, puede absorber variaciones, aprender con el uso y aumentar la cobertura a lo largo del tiempo, siempre que exista gobernanza, monitoreo y un traspaso bien diseñado, claro.

Comparativa práctica: 8 criterios para decidir

Para ayudarlo a decidir qué modelo funciona mejor para su operación, presentamos a continuación los principales criterios que los líderes de CX/Soporte suelen analizar antes de tomar una decisión. ¡Mira!

Criterio | Chatbot de árbol de decisión | Agente de IA |

Cobertura real | Resuelve solo casos simples y predecibles. Las excepciones suelen caer en la atención humana. | Resuelve más casos de punta a punta, incluso con variaciones de lenguaje y contexto. |

Mantenimiento | Realizado manualmente, exige actualización constante de flujos. Cada excepción se convierte en un nuevo nodo. | Evoluciona con uso y monitoreo. Los ajustes se centran en bases, políticas e intenciones. Por lo tanto, menos retrabajo estructural. |

Experiencia del cliente | Alta fricción cuando el cliente se sale del guion. Menús largos y “no entendí” son comunes. | Conversación más fluida, adaptada a la forma en que el cliente escribe y pregunta. |

Tiempo de implementación | Rápido al principio, pero se vuelve más complejo con el tiempo. | Puede llevar desde unos días hasta semanas, dependiendo de la base y las integraciones, pero ya nace más completo. |

Integraciones y acciones | Limitadas o inexistentes. Generalmente informativo. | Consulta sistemas, ejecuta acciones y sigue procesos reales de atención. |

Escalabilidad | Cuando el volumen se duplica, la complejidad y el esfuerzo de mantenimiento se duplican también. | Escala mejor con volumen y variación, manteniendo la misma estructura base. |

Gobernanza y riesgo | Control total de la respuesta, pero poca flexibilidad. | Exige gobernanza (políticas, auditoría, fallback), pero permite equilibrio entre control y autonomía. |

Costo y previsibilidad | Generalmente costo fijo, incluso con baja resolución real. | Los modelos varían (licencia, uso o resolución), con potencial para alinear costo a resultado. |

El error más común: intentar “forzar IA” sobre un proceso roto

Un agente de IA no corrige problemas estructurales del servicio. Cuando la base de conocimiento es débil, nadie mide resultados y la transición al equipo humano es confusa, la IA termina convirtiéndose en el chivo expiatorio. El discurso se convierte en “la IA se equivoca”, cuando, en la práctica, el proceso ya no funcionaba antes.

💡 No por casualidad, la Harvard Business Review señala que alrededor del 70% de los proyectos de IA fracasan cuando intentan escalar sin un alcance claro, datos consistentes y gobernanza.

Este error suele aparecer cuando la empresa salta algunos pasos:

automatiza sin saber cuáles son los principales motivos de contacto;

no define criterios claros de respaldo;

no establece responsables por la evolución del servicio.

El resultado es predecible: baja resolución, frustración del cliente y resistencia del propio equipo interno.

Por otro lado, existen señales claras de que la implementación tiene todo para tener éxito. Normalmente, estas operaciones:

Tienen los principales motivos de contacto bien mapeados, especialmente en el N1.

Poseen una base mínima de conocimiento, incluso si no es perfecta.

Definen un responsable del proyecto, encargado de métricas, ajustes y decisiones.

Mantienen una rutina continua de monitoreo y mejora, observando errores, escapes y comentarios del equipo humano.

Cuando estos elementos están presentes, la IA deja de ser una promesa arriesgada y se convierte en un componente predecible de la operación. No se trata de “activar la IA”, sino de construir un sistema que aprende, evoluciona y entrega resultados a lo largo del tiempo.

Cómo implementarlo de la manera correcta (plan de 15–30 días)

Recomendación final: qué elegir en tu caso

Preguntas frecuentes

¿Cuál es la principal diferencia entre un chatbot de árbol y un agente de IA?

Los chatbots de árbol siguen flujos fijos y reglas predefinidas. Los agentes de IA entienden la intención del cliente, consideran el contexto y pueden adaptar la respuesta o realizar acciones, sin depender de flujos rígidos.

¿El chatbot de árbol de decisión aún funciona?

Sí, funciona en escenarios simples y predecibles, como dudas básicas, triage o información fija.

¿Puede un agente de IA cometer errores en la atención?

Puede, como cualquier sistema o humano. La diferencia es que los agentes de IA funcionan mejor con gobernanza: límites claros, transferencia a humanos y monitoreo constante. El error más común es poner a la IA a funcionar sin una base de conocimiento o sin seguimiento.

¿Vale la pena cambiar un chatbot tradicional por un agente de IA?

Depende del escenario. Si la atención es simple y el volumen es bajo, el chatbot tradicional puede ser suficiente. Si hay un alto volumen, se tiene WhatsApp como canal principal y necesidad de resolver casos de extremo a extremo, el agente de IA tiende a ofrecer más resultados.

¿El agente de IA reemplaza al equipo de atención?

No. Reduce el volumen de atenciones repetitivas (N1) y libera al equipo humano para casos más complejos. En la práctica, la IA actúa como una capa de escala, no como una sustitución total.

¿Implementar un agente de IA lleva mucho tiempo?

No necesariamente. Muchas operaciones comienzan con un piloto en pocas semanas, enfocándose en los principales motivos de contacto. El secreto es empezar pequeño, medir resultados y expandir gradualmente.

¿Funciona bien el chatbot en WhatsApp?

Los chatbots de árbol suelen generar fricción en WhatsApp, porque el cliente espera conversar, no navegar por menús. Los agentes de IA se adaptan mejor a este canal, por entender el lenguaje natural y el contexto de la conversación.

¿Qué saber si el chatbot está funcionando bien?

Tasa de retención (casos resueltos por la IA), tasa de transferencia a humano, tiempo de resolución, quejas y CSAT. Si estos indicadores no mejoran, la automatización no está generando un impacto real.